Mitigación de la creciente amenaza a la seguridad biométrica que plantean las imágenes digitales falsas y los ataques de inyección

Los deepfakes son imágenes digitales renderizadas (como efectos especiales en una película) que permiten a un estafador crear videos realistas y usarlos para burlar la seguridad biométrica. Las preocupaciones sobre el fraude están aumentando a medida que la tecnología para crear deepfakes se vuelve cada vez más accesible.

La amenaza de los deepfakes es considerable. Los datos de una nueva encuesta de ID RD muestran que el 91% de las empresas reconocen que ellas o sus clientes están preocupados por el fraude de deepfakes, y el 42% ha sufrido ataques de deepfakes. Además, el 84% de los mismos encuestados expresa una preocupación similar por los ataques de inyección, y el 37% ha tenido contacto directo con ellos. En 2023, el 20% de los ataques exitosos de robo de cuentas se basarán en deepfakes ( Gartner ).

Este artículo presenta varios tipos de deepfakes, cómo se utilizan en ataques para vencer la seguridad biométrica y cómo la amenaza se mitiga. Para obtener más información, consulte nuestro documento técnico (white paper).

Generación de imágenes fraudulentas: deepfakes y cheapfakes

Los deepfakes son un tipo de medios sintéticos que evoluciona rápidamente y en los que se utiliza inteligencia artificial (IA) para generar imágenes digitales de aspecto realista que muestran a personas reales haciendo o diciendo cosas que nunca hicieron o dijeron, o incluso inventando personas que en realidad no existen. Según el Instituto de Investigación Idiap , el 95 % de los sistemas de reconocimiento facial no pueden detectar deepfakes.

A diferencia de las fotos y las repeticiones de pantalla que se “presentan” a la cámara en un medio físico (un ataque de presentación), las deepfakes son nativamente digitales, creadas mediante el aprendizaje automático basado en redes neuronales profundas. Los deepfakes realistas se pueden “inyectar” en un dispositivo mediante ataques de hardware y software de una manera que evite la cámara (un ataque de inyección), lo que dificulta la detección de ataques de presentación.

Cheapfakes (Falsificaciones baratas) Son una clase de medios falsos que son fáciles y rápidos de producir, especialmente para usuarios aficionados. En comparación con los deepfakes tradicionales, los cheapfakes no requieren codificación sofisticada, ajuste manual de redes neuronales o habilidades de posproducción. Los expertos destacan que las falsificaciones baratas pueden ser peligrosas porque su fabricación requiere poco esfuerzo y dinero.

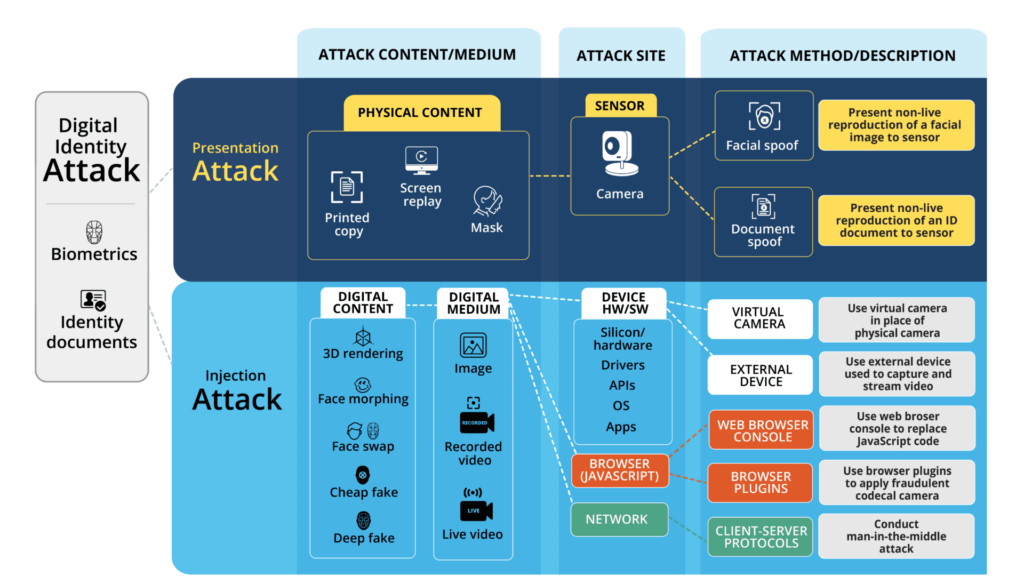

Entrega de imágenes fraudulentas: ataques de presentación y ataques de inyección

Hay dos clases de ataques a los sistemas biométricos que tienen como objetivo falsificar la biometría al anular la detección de vida: ataques de presentación y ataques de inyección.

Los ataques de presentación implican “presentar” imágenes no en vivo a la cámara durante el proceso de captura y representarlas como en vivo utilizando medios físicos , como fotografías en papel y pantallas digitales.

Los ataques de inyección implican hackeos de hardware o software que permiten a un estafador “inyectar” imágenes digitales de tal manera que se evita un proceso de captura adecuado con la cámara principal.

Consideremos un ataque análogo en el que se intercepta una transmisión satelital de un discurso en vivo de un líder político y se reemplaza por un video digital falso en el que dice algo diferente. La audiencia cree que está viendo un discurso en vivo de su líder, cuando en realidad está viendo un discurso grabado de un video falso en el que dice algo diferente. La detección de ataques de inyección ayuda a mitigar esta amenaza en el ámbito de la seguridad biométrica.

Figura: diagrama del contenido, los sitios y los métodos de ataque

La inyección de imágenes falsas puede tener lugar en cualquiera de los distintos sitios de ataque dentro de un dispositivo mediante ataques de hardware o software. Algunos ejemplos de ataques de inyección son:

|

Ataques de hardware

|

Ataques de software

|

Ataques de red

|

Mitigar el riesgo: detectar ataques

A diferencia de los medios físicos utilizados para los ataques de presentación, como fotografías en papel y pantallas, los deepfakes y los ataques digitales relacionados. El contenido renderizado plantea un tipo diferente de amenaza. Si bien los deepfakes se pueden usar en ataques de presentación de repetición de pantalla, estos se pueden mitigar con PAD (Presentation Atack Detection, o Detección de ataques de presentación). Pero también se pueden usar en ataques de inyección que, como se describió anteriormente, pasan por alto la cámara y, por lo tanto, requieren métodos de detección diferentes.

Con la evolución de los deepfakes, las contramedidas para combatirlos también han avanzado. Existen numerosos métodos en función de los datos disponibles para el análisis:

- Análisis multimodal . La IA analiza el movimiento de los labios y las formas de la boca para detectar discrepancias.

- Técnicas de marca de agua y firma digital . Estos métodos requieren calcular un hash o utilizar una técnica que inserta una señal o código digital oculto en un vídeo que se puede utilizar para identificar el origen del vídeo.

- Análisis de video . Esto incluye un amplio espectro de diferentes enfoques basados en el aprendizaje automático y redes neuronales profundas, incluidos el análisis de movimiento, el análisis cuadro por cuadro y los detectores de artefactos de imagen .

- Detección de ataques por inyección digital .Estos métodos se basan en detectar la omisión del proceso de captura normal de una cámara adecuada, como se describió anteriormente . Pueden recopilar información adicional del sistema operativo, el navegador y cualquier software y hardware que se utilice para la captura de video. Se recopila una amplia gama de información y se compara con la que se sabe que es una captura adecuada y la que se sabe que es un ataque de inyección.

En resumen: un enfoque integral de la verificación de vida incluye la detección de ataques de presentación e inyección.

En definitiva, no se puede exagerar la importancia de proteger la seguridad biométrica de los deepfakes y los ataques de inyección, dado el rápido avance y la proliferación del software de renderización de deepfakes. Los deepfakes tienen el potencial de comprometer gravemente la autenticación biométrica, y es fundamental que las organizaciones tomen medidas para protegerse contra ellos. Al utilizar la detección de ataques de presentación junto con la detección de ataques de inyección, las organizaciones pueden garantizar mejor la integridad de sus sistemas.

Fuente: www.antispoofing.org